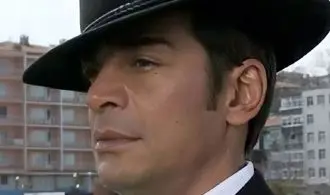

پدرخوانده هوش مصنوعی چرا از مخلوق خود میترسد؟

پارسینه: دکتر هینتون که به «پدرخوانده هوش مصنوعی» معروف است، پس از یک دهه همکاری با گوگل، از این شرکت خداحافظی کرد. او اکنون از آینده توسعه هوش مصنوعی به شدت هراسان است.

به گزارش «پارسینه» به نقل از نیویورک تایمز، جفری هینتون از پیشگامان هوش مصنوعی است. در سال ۲۰۱۲، دکتر هینتون و دو تن از دانشجویان فارغ التحصیلش در دانشگاه تورنتو فناوریای ایجاد کردند که به پایه فکری سامانههای هوش مصنوعی تبدیل شد که بزرگترین شرکتهای صنعت فناوری معتقدند کلیدی برای آینده آنهاست.

با این حال، روز دوشنبه، جفری هینتون رسماً به جمع رو به رشدی از منتقدان پیوست که میگویند این شرکتها با رویکرد تهاجمی خود برای ایجاد محصولاتی مبتنی بر هوش مصنوعی مولد، فناوریای که به چتباتهای محبوبی مانند ChatGPT نیرو میدهد، به سوی خطر رقابت میکنند.

دکتر هینتون گفت که او شغل خود را در گوگل، جایی که بیش از یک دهه در آن کار کرده و به یکی از معتبرترین افراد در این زمینه تبدیل شده، رها کرده است و بنابراین میتواند آزادانه در مورد خطرات هوش مصنوعی صحبت کند. او گفت اکنون بخشی از وجودش از زندگی کاریش پشیمان است.

دکتر هینتون طی یک مصاحبه طولانی که هفته گذشته در اتاق غذاخوری خانه اش در تورنتو انجام شد، گفت: «من همان بهانه معمول را برای آرام کردن خودم دارم: اگر من این کار را نمیکردم، کس دیگریا انجام میداد.»

چرخش دکتر هینتون از پیشگامی هوش مصنوعی به پیشگویی درباره فاجعه پیش رو، لحظهای قابل توجه برای صنعت فناوری در مهمترین نقطه عطف آن در دهههای اخیر است. رهبران صنعت بر این باورند که سامانههای هوش مصنوعی جدید میتوانند به اندازه معرفی مرورگر وب در اوایل دهه ۱۹۹۰ مهم باشند و میتوانند به پیشرفتهایی در حوزههای مختلف از تحقیقات دارویی تا آموزش منجر شوند.

اما ترس و نگرانی بسیاری از آشنایان صنعت این است که آنها چیزی خطرناک را در طبیعت رها میکنند. هوش مصنوعی مولد میتواند ابزاری برای تولید طلاعات نادرست باشد. به زودی، ممکن است به خطری برای مشاغل تبدیل شود. نگرانترین افراد دنیای فناوری پا را فراتر میگذارند و میگویند این فناوری میتواند خطری برای بشریت باشد.

دکتر هینتون گفت: «به سختی میتوان تصور کرد که جلوی استفاده بازیگران بد برای کارهای بد را بگیرید.»

پس از انتشار نسخه جدید «چت جی پی تی» توسط «اوپنای آی» در سانفرانسیسکو در ماه مارس، بیش از ۱۰۰۰ رهبر فناوری و پژوهشگر با امضای نامهای سرگشاده خواستار توقف دست کم شش ماهه توسعه سیستمهای جدید شدند، زیرا فناوریهای هوش مصنوعی خطرات عمیقی را برای جامعه و بشریت به همراه دارد.

چند روز بعد، ۱۹ نفر از رهبران فعلی و سابق «انجمن پیشرفت هوش مصنوعی»، یک انجمن دانشگاهی ۴۰ ساله، نامهای منتشر کردند و در مورد خطرات هوش مصنوعی هشدار دادند. این گروه شامل اریک هورویتز، مدیر ارشد علمی مایکروسافت میشد که فناوری «اوپنای آی» را در طیف وسیعی از محصولات خود، از جمله موتور جستجوی بینگ، به کار گرفته است.

دکتر هینتون که اغلب او را «پدرخوانده هوش مصنوعی» مینامند، هیچ یک از این نامهها را امضا نکرده و گفته بود که تا زمانی که شغل خود را رها نکرده باشد نمیخواهد علناً از گوگل یا سایر شرکتها انتقاد کند. او ماه گذشته به شرکت اطلاع داد که به دنبال استعفا است و روز پنجشنبه با ساندار پیچای، مدیر اجرایی شرکت مادر گوگل، آلفابت، تلفنی صحبت کرد. او از صحبت علنی درباره جزئیات گفتگوی خود با آقای پیچای خودداری کرد.

جف دین، دانشمند ارشد گوگل، در بیانیهای گفت: «ما به رویکردی مسئولانه در زمینه هوش مصنوعی متعهدیم و به طور مستمر در حال یادگیری برای درک خطرات نوظهور و در عین حال به شکلی جسورانه دنبال نوآوری هستیم.»

دکتر هینتون، یک مهاجر ۷۵ ساله بریتانیایی است که عمری را در دانشگاه صرف کرده است و اعتقادات شخصیاش در مورد توسعه و استفاده از هوش مصنوعی حرفه او را پیش برده است. او در سال ۱۹۷۲ ایدهای به نام شبکه عصبی را پذیرفت. شبکه عصبی یک سیستم ریاضیاتی است که با تجزیه و تحلیل داده ها، مهارتها را یاد میگیرد. در آن زمان، تعداد کمی از محققان به این ایده اعتقاد داشتند.

در دهه ۱۹۸۰، دکتر هینتون استاد علوم کامپیوتر در دانشگاه کارنگی ملون بود، اما این دانشگاه را به مقصد کانادا ترک کرد، زیرا تمایلی به دریافت بودجه پنتاگون نداشت. در آن زمان، بیشتر تحقیقات هوش مصنوعی در ایالات متحده توسط وزارت دفاع تامین مالی میشد. دکتر هینتون عمیقاً با استفاده از هوش مصنوعی در میدان جنگ مخالف است - چیزی که او آن را «روباتهای سرباز» مینامد.

در سال ۲۰۱۲، دکتر هینتون و دو تن از شاگردانش در تورنتو، ایلیا سوتسکور و الکس کریشفسکی، یک شبکه عصبی ساختند که میتوانست هزاران عکس را تجزیه و تحلیل کند و به خود بیاموزد که اشیاء معمولی مانند گلها، سگها و ماشینها را شناسایی کند.

گوگل ۴۴ میلیون دلار برای تصاحب شرکتی که توسط دکتر هینتون و دو شاگردش راه اندازی شده بود هزینه کرد و سیستم آنها منجر به ایجاد فناوریهای قدرتمندتر، از جمله چتباتهای جدید مانند «چت جی پی تی» و «گوگل بارد» شد. آقای سوتسکورهم به عنوان دانشمند ارشد در «اوپنای آی» انتخاب شد. در سال ۲۰۱۸، دکتر هینتون و دو همکار قدیمی اش جایزه تورینگ را که اغلب «جایزه نوبل رایانش» نامیده میشود، برای کارشان در شبکههای عصبی دریافت کردند.

تقریباً در همان زمان، گوگل، «اوپنای آی» و سایر شرکتها شروع به ساخت شبکههای عصبی کردند که از حجم عظیمی از نائت دیجیتال یاد میگرفتند. دکتر هینتون فکر میکرد که این روشی قدرتمند برای ماشینها برای درک و تولید زبان است، اما نسبت به روشی که انسانها با زبان کار میکنند پایینتر بود.

سپس، سال گذشته، زمانی که گوگل و اوپنای آی سیستمهایی را با استفاده از مقادیر بسیار بیشتری از دادهها ساختند، دیدگاه او تغییر کرد. او هنوز معتقد بود که این سیستمها از جهاتی از مغز انسان پایینتر هستند، اما فکر میکرد که از جهاتی هوش انسان را تحت الشعاع قرار میدهند. او گفت: «شاید آنچه در این سیستمها میگذرد، در واقع بسیار بهتر از آنچه در مغز میگذرد باشد.»

او معتقد است، همانطور که شرکتها سیستمهای هوش مصنوعی خود را بهبود میبخشند، آنها به طور فزایندهای خطرناک میشوند. او درباره فناوری هوش مصنوعی گفت: «ببینید که پنج سال پیش چگونه بود و اکنون چگونه است. تفاوت را بگیرید و همین طور پیش بروید. این ترسناک است.»

او گفت تا سال گذشته، گوگل به عنوان یک «ناظر مناسب» برای این فناوری عمل میکرد و مراقب بود چیزی را منتشر نکند که ممکن است باعث آسیب شود. اما اکنون که مایکروسافت موتور جستجوی بینگ خود را با یک چتبات تقویت کرده است - که تجارت اصلی گوگل را به چالش میکشد - گوگل در حال رقابت برای به کارگیری همان نوع فناوری است. دکتر هینتون گفت که غولهای فناوری در رقابتی گرفتار شده اند که توقف آن شاید غیرممکن باشد.

نگرانی فوری او این است که اینترنت مملو از عکسها، فیلمها و متنهای نادرست شود و یک فرد معمولی «دیگر نمیتواند بفهمد چه چیزی درست است.»

او همچنین نگران است که فناوریهای هوش مصنوعی به مرور زمان بازار کار را متحول کند. امروزه، چتباتهای مانند چت جی پی تی مکمل کارکنان انسانی هستند، اما میتوانند جایگزین مشاوران حقوقی، دستیاران شخصی، مترجمان و دیگرانی شوند که کارهای عادی را انجام میدهند.

در ادامه، او نگران است که نسخههای آینده این فناوری تهدیدی برای بشریت باشند، زیرا آنها اغلب مواقع رفتارهای غیرمنتظرهای را از حجم عظیمی از دادههایی که تجزیه و تحلیل میکنند یاد میگیرند. او گفت که این موضوع به یک مشکل تبدیل میشود، زیرا افراد و شرکتها به سیستمهای هوش مصنوعی اجازه میدهند نه تنها کد کامپیوتری خودشان را تولید کنند، بلکه در واقع آن کد را خودشان اجرا کنند و او از روزی میترسد که سلاحهای خودمختار واقعی -آن روباتهای قاتل- به واقعیت تبدیل شوند.

او گفت: «این ایده که این چیزها واقعاً میتوانند هوشمندتر از آدمها باشند. چند نفر آن را باور داشتند، اما بیشتر مردم فکر میکردند که خیلی دور از ذهن است؛ و من فکر میکردم خیلی دور است. فکر میکردم ۳۰ تا ۵۰ سال یا حتی بیشتر فاصله داشته باشد. بدیهی است که دیگر چنین فکری نمیکنم.»

بسیاری دیگر از کارشناسان، از جمله بسیاری از دانشجویان و همکاران وی، میگویند این تهدید فرضی است. اما دکتر هینتون معتقد است که رقابت بین گوگل و مایکروسافت و دیگران به یک مسابقه جهانی تبدیل خواهد شد که بدون نوعی مقررات جهانی متوقف نخواهد شد.

البته او میگوید متوقف کردن توسعه هوش مصنوعی شاید غیرممکن باشد. او گفت برخلاف سلاحهای هسته ای، هیچ راهی برای دانستن اینکه آیا شرکتها یا کشورها به طور مخفیانه روی این فناوری کار میکنند وجود ندارد. بهترین امید این است که دانشمندان برجسته جهان برای شیوههای کنترل فناوری با یکدیگر همکاری کنند. او گفت: «من فکر نمیکنم تا زمانی که درنیابند میتوانند آن را کنترل کنند یا نه، نباید این فناوری را توسعه دهند.»

دکتر هینتون گفت که وقتی مردم از او میپرسیدند چگونه میتواند روی فناوریای که بالقوه خطرناک است کار کند، از رابرت اوپنهایمر که تلاشهای آمریکا برای ساخت بمب اتمی را رهبری میکرد، نقل قول میکند که «وقتی چیزی را میبینی که از نظر فنی شیرین است، برو و انجامش بده.»

او دیگر این را نمیگوید.

.svg)

ارسال نظر