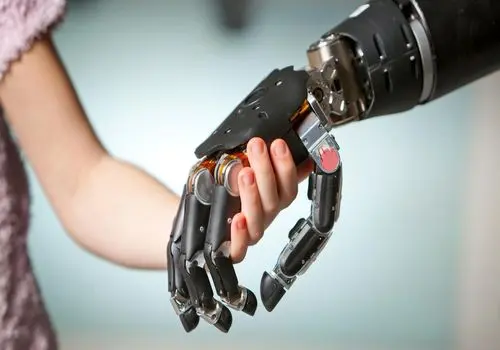

رباتی که با دیدن لمس میکند و با لمس کردن میبیند!

پارسینه: محققان موسسه فناوری ماساچوست (MIT) رباتی ساختهاند که مانند انسان میتواند جنس اشیای مختلف را با دیدن و یا شکلشان را با لمس کردن تشخیص دهد.

برای انسانها آسان است که با نگاه کردن به یک شیء جنس آن را حدس بزنند یا اینکه با لمس کردن یک شیء بگویند که چه شکل و شمایلی دارد، اما این کار برای رباتها یک چالش بزرگ است. در حال حاضر دانشمندان آزمایشگاه علوم رایانه و هوش مصنوعی مؤسسه فناوری ماساچوست (CSAIL) یک ربات جدید ساختهاند که تلاش میکند این عمل انسان را انجام دهد.

این تیم از یک بازوی رباتیک متعلق به رباتی به نام "کوکا" (KUKA) و یک حسگر لمسی به نام "ژلسایت" (GelSight) استفاده کرد. بدین ترتیب اطلاعات جمع آوری شده توسط "ژلسایت" به هوش مصنوعی ارسال میشود تا بتواند ارتباط بین اطلاعات تصویری و لمسی را شناسایی کند.

برای آموزش چگونگی شناسایی اشیا با لمس به هوش مصنوعی، محققان ۱۲ هزار فیلم از لمس ۲۰۰ شیء مختلف مانند پارچه، ابزار و لوازم خانگی را ضبط کردند. سپس فیلمها به تصاویر ساکن تجزیه شدند و هوش مصنوعی با استفاده از این مجموعه دادهها برای اتصال دادههای لمسی و بصری استفاده کرد.

"یونژو لی" دانشجوی دکترا در MIT و محقق اصلی این پروژه میگوید: مدل ما میتواند با نگاه کردن به صحنه، احساس لمس را تصور کند و یا لمس کورکورانه یک شیء میتواند شکل ظاهری آن را پیشبینی کند.

وی افزود: گردآوری این دو حس با هم میتواند ربات را قدرتمند کند و نیاز اطلاعاتی وظایف مربوط به رباتها را کاهش دهد.

در حال حاضر این ربات تنها میتواند اشیا را در یک محیط کنترل شده شناسایی کند. گام بعدی ایجاد یک مجموعه داده بزرگتر است تا ربات بتواند در تنظیمات و محیطهای متنوع کار کند.

"اندرو اونز" دانشجوی فوق دکتری در دانشگاه کالیفرنیا برکلی میگوید: روشهایی مثل این، پتانسیل بسیار زیادی برای رباتیک فراهم میآورند، جایی که شما نیاز به پاسخ به سوالاتی مانند این شیء سخت است یا نرم، دارید یا مثلاً ربات به خود بگوید اگر من این لیوان را بردارم چقدر خوب میتوانم آن را نگه دارم. این یک مشکل بسیار چالش برانگیز است، زیرا سیگنالها خیلی متفاوت هستند و این مدل قابلیت بزرگی را از خود نشان داده است.

این تیم از یک بازوی رباتیک متعلق به رباتی به نام "کوکا" (KUKA) و یک حسگر لمسی به نام "ژلسایت" (GelSight) استفاده کرد. بدین ترتیب اطلاعات جمع آوری شده توسط "ژلسایت" به هوش مصنوعی ارسال میشود تا بتواند ارتباط بین اطلاعات تصویری و لمسی را شناسایی کند.

برای آموزش چگونگی شناسایی اشیا با لمس به هوش مصنوعی، محققان ۱۲ هزار فیلم از لمس ۲۰۰ شیء مختلف مانند پارچه، ابزار و لوازم خانگی را ضبط کردند. سپس فیلمها به تصاویر ساکن تجزیه شدند و هوش مصنوعی با استفاده از این مجموعه دادهها برای اتصال دادههای لمسی و بصری استفاده کرد.

"یونژو لی" دانشجوی دکترا در MIT و محقق اصلی این پروژه میگوید: مدل ما میتواند با نگاه کردن به صحنه، احساس لمس را تصور کند و یا لمس کورکورانه یک شیء میتواند شکل ظاهری آن را پیشبینی کند.

وی افزود: گردآوری این دو حس با هم میتواند ربات را قدرتمند کند و نیاز اطلاعاتی وظایف مربوط به رباتها را کاهش دهد.

در حال حاضر این ربات تنها میتواند اشیا را در یک محیط کنترل شده شناسایی کند. گام بعدی ایجاد یک مجموعه داده بزرگتر است تا ربات بتواند در تنظیمات و محیطهای متنوع کار کند.

"اندرو اونز" دانشجوی فوق دکتری در دانشگاه کالیفرنیا برکلی میگوید: روشهایی مثل این، پتانسیل بسیار زیادی برای رباتیک فراهم میآورند، جایی که شما نیاز به پاسخ به سوالاتی مانند این شیء سخت است یا نرم، دارید یا مثلاً ربات به خود بگوید اگر من این لیوان را بردارم چقدر خوب میتوانم آن را نگه دارم. این یک مشکل بسیار چالش برانگیز است، زیرا سیگنالها خیلی متفاوت هستند و این مدل قابلیت بزرگی را از خود نشان داده است.

منبع:

خبرگزاری ایسنا

.svg)

ارسال نظر